فهرست مطالب:

تصویری: دستکش تبدیل گفتار/نوشتار: 5 مرحله

2024 نویسنده: John Day | [email protected]. آخرین اصلاح شده: 2024-01-30 08:53

ایده/انگیزه اجرای این پروژه کمک به افرادی بود که در برقراری ارتباط با استفاده از گفتار مشکل دارند و با استفاده از حرکات دست یا بیشتر به عنوان زبان امضای آمریکایی (ASL) شناخته می شوند. این پروژه می تواند گامی در جهت فراهم آوردن فرصتی برای این افراد برای کار با سایر افراد ، که نمی توانند زبان اشاره را درک کنند ، در یک محیط مشارکتی باشد. همچنین ، این پروژه به آنها این امکان را می دهد که بدون استفاده از مترجم واقعی ، سخنرانی های عمومی داشته باشند. در ابتدا ، من فقط سعی می کردم برخی از حرکات ساده تر مانند الفبای A ، B ، I و غیره را تشخیص دهم و همچنین حرکات خاصی را به کلمات/سلام های رایج مانند "سلام" ، "صبح بخیر" و غیره اختصاص داده ام.

مرحله 1: مونتاژ مدار

مرحله 2: جزئیات پروژه

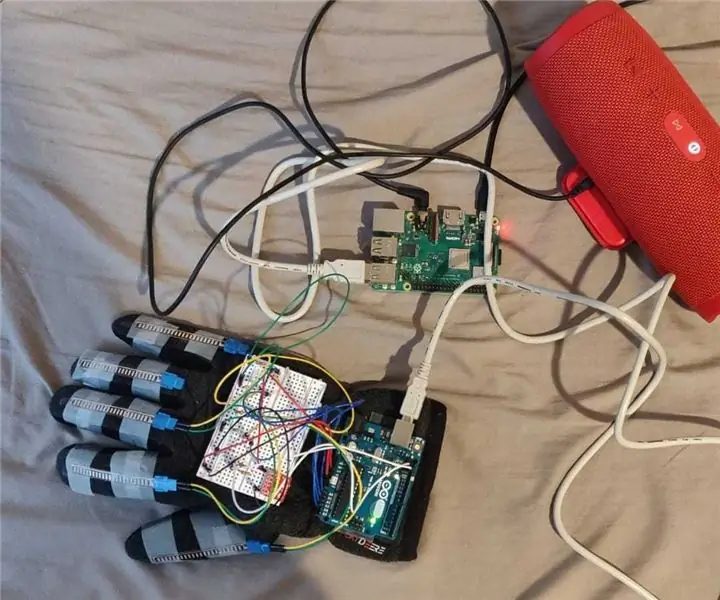

این پروژه شامل یک دستکش پوشیدنی با 4 سنسور انعطاف پذیر است که در دستکش تعبیه شده است - هر کدام یکی برای انگشتان کوچک ، وسط ، انگشت اشاره و شست. به دلیل محدودیت در دسترس بودن پین های ورودی آنالوگ در Arduino Uno R3 و به طور کلی به دلیل عدم وجود حرکت مستقل که توسط انگشت در زبان اشاره نشان داده می شود ، از سنسور فلکس برای حلقه استفاده نمی شود. شتاب سنج MMA8452Q نیز استفاده می شود که در پشت دست چسبانده شده است تا جهت دست اندازه گیری شود. ورودی این سنسورها تجزیه و تحلیل شده و برای حس حرکت استفاده می شود. هنگامی که حرکت حس شد ، شخصیت/پیام مربوطه در یک متغیر ذخیره می شود. این شخصیت ها و پیام ها همچنان به هم متصل می شوند تا زمانی که یک حرکت از پیش تعیین شده مشخص شود که نشان دهنده اتمام جمله است. به محض تشخیص این حرکت خاص ، رشته جمله ذخیره شده توسط آردوینو از طریق کابل USB به Raspberry Pi ارسال می شود. سپس رزبری پای رشته دریافتی را به سرویس ابر آمازون با نام Polly ارسال می کند تا جمله دریافت شده در قالب متن را به قالب گفتار تبدیل کند و سپس گفتار دریافتی را از طریق کابل AUX روی بلندگوی متصل به رزبری پای پخش می کند.

این پروژه فقط اثبات مفهوم بود و با تجهیزات و برنامه ریزی بهتر و کالیبره شده برای تشخیص بسیاری از حرکات و حرکات دیگر. در حال حاضر ، تنها قابلیت های محدودی در این پروژه برنامه ریزی شده است ، مانند تشخیص حرکت اولیه و خروجی متن به گفتار.

مرحله 3: کد

مرحله 4: مراحل

1. طبق سنسور مدار ارائه شده ، سنسورهای فلکس و شتاب سنج MMA8452Q را به آردوینو وصل کنید.

2. برنامه Final_Project.ino (موجود در فایل Arduino_code.zip) را در Arduino بریزید.

3. آردوینو را با کابل USB به Raspberry Pi متصل کنید. (کابل نوع A/B).

4. Raspberry Pi را روشن کنید ، فایل Raspberry_pi_code.zip را در Raspberry Pi کپی کرده و آن را استخراج کنید. بلندگو را به رزبری پای وصل کنید.

5. اعتبارنامه حساب AWS خود یعنی aws_access_key_id ، aws_secret_access_key و aws_session_token را در فایل ential/.aws/اعتبارنامه کپی کنید. این مرحله برای ارتباط با ابر AWS و استفاده از خدمات AWS لازم است.

6. برنامه seria_test.py موجود در پوشه استخراج شده را در مرحله 4 اجرا کنید.

7. حال با اشاره حرکت کنید و یک جمله بسازید و سپس حرکت مخصوص را انجام دهید (انگشتان دست و کف دست خود را صاف و در خطی قرار دهید که کف دست شما رو به طرف شما باشد و سپس مچ دست را بچرخانید و به سمت پایین بچرخانید به گونه ای که حالا کف دست شما رو به شما است و نوک انگشتان شما به سمت پایین به سمت پای شما است.) برای نشان دادن تکمیل جمله.

8. ترمینال را برای اطلاعات مفید بررسی کنید.

9. و به سخنرانی تبدیل شده ای که در بلندگو پخش می شود ، گوش دهید.

مرحله 5: منابع

1. https://learn.sparkfun.com/tutorials/mma8452q-accelerometer-breakout-hookup-guide#hardware- Overview

2.

3.

4.

توصیه شده:

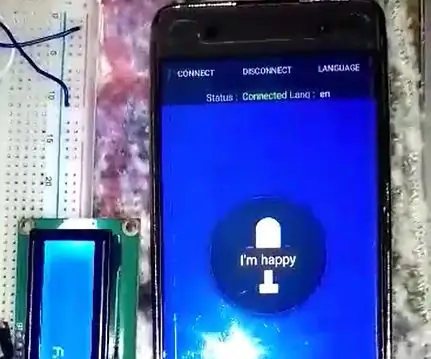

تشخیص گفتار با آردوینو (بلوتوث + LCD + اندروید): 6 مرحله

تشخیص گفتار با آردوینو (بلوتوث + LCD + اندروید): در این پروژه ، ما قصد داریم تشخیص گفتار را با آردوینو ، ماژول بلوتوث (HC-05) و LCD انجام دهیم. بیایید دستگاه تشخیص گفتار خود را بسازیم

آموزش نوشتار درخشان در فتوشاپ: 16 مرحله

آموزش نوشتار زرق و برق در فتوشاپ: به عنوان طراح گرافیک میانی و کلیات چند رسانه ای ، فونت متن درخشان با درخواست طراحی رایج است. در این دستورالعمل ، من مراحل دستیابی به فونت متن درخشان را به صورت گرافیکی نشان خواهم داد

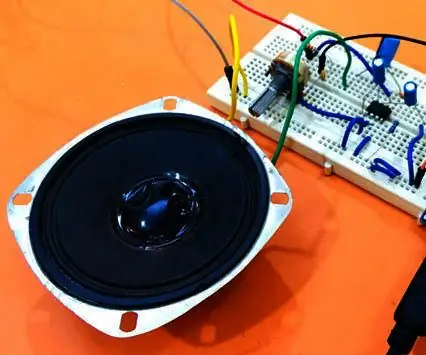

تبدیل متن به گفتار آردوینو با استفاده از LM386 - پروژه صحبت کردن آردوینو - کتابخانه تاکی آردوینو: 5 مرحله

تبدیل متن به گفتار آردوینو با استفاده از LM386 | پروژه صحبت کردن آردوینو | کتابخانه Talkie Arduino: سلام بچه ها ، در بسیاری از پروژه ها ما به arduino نیاز داریم که چیزی شبیه به ساعت صحبت کردن یا گفتن برخی اطلاعات در این دستورالعمل را با استفاده از Arduino به گفتار تبدیل کنیم

بحث حبابی: گفتار خود را به حباب تبدیل کنید!: 6 مرحله (همراه با تصاویر)

بحث حبابي: گفتار خود را به حباب تبديل كنيد! Varro (116 قبل از میلاد - 27 قبل از میلاد) ، De Re Rustica حباب صابون زودگذر است. فقط برای یک لحظه کوتاه طول می کشد و

دستکش جادوگر: دستکش کنترل کننده آردوینو: 4 مرحله (همراه با تصاویر)

دستکش جادوگری: یک دستکش کنترل کننده آردوینو: دستکش جادوگر. در پروژه من یک دستکش ساخته ام که می توانید از آن برای بازی بازیهای جادویی مورد علاقه خود به شیوه ای سرد و همهجانبه و تنها با استفاده از چند دارایی اصلی آردوینو و آردوینو استفاده کنید. می توانید بازی هایی مانند طومارهای بزرگتر انجام دهید یا